totoleouf

-

Compteur de contenus

109 -

Inscription

-

Dernière visite

-

Jours gagnés

1

Messages posté(e)s par totoleouf

-

-

il y a 10 minutes, maxou56 a dit :

Mettre la capture de "cristalDiskinfo" n'apporte pas vraiment d'info.

Car déchirer les valeurs brutes ?? Par exemple Heures de fonctionnement 00000000B ??

D'autres logiciels "SMART" ou même sur le NAS sont plus claires.

euh!!! la c'est pas du binaire sur la ligne du nombre de secteurs HS réaloués

et parceque j'avais que ça sous la main!

sinon dès que j'ai branché le HDD dans le NAS, celui-ci m'a mis en garde en me demandant de remplacer ce HDD rapidement car 2 secteurs HS (comme sur la capture image).

0 -

-

Il y a 2 heures, firlin a dit :

Tu as supprimé l'argument -b 4096 pour lancer le badblock @totoleouf

j'ai fait la manip sous windows et après j'ai lancé la commande en supprimant l'argument -b 4096, mais je n'ai pas fait le test avec non plus...

0 -

c'est bon 😱

root@xxxx:~# badblocks -nvs -c 393216 /dev/sdq > /volume3/docker/sdq.log 2>&1 &

[8] 13934

root@xxxx:~# tail -f /volume3/docker/sdq.log

Checking for bad blocks in non-destructive read-write mode

From block 0 to 1176469503

Checking for bad blocks (non-destructive read-write test)

Testing with random pattern: ^C0.07% done, 0:27 elapsed. (0/0/0 errors)plus qu'à attendre!

merci pour votre aide en tout cas!

0 -

ok je verrais après manger alors.

merci en tout cas

je vous fait retour tout a l'heure

0 -

rien à faire, j'ai éjecté le HDD et rebranché

toujours pareil erreur:

/dev/sdq is apparently in use by the system; it's not safe to run badblocks!

0 -

j'ai supprimer l'argument b

idem...

0 -

j'ai ce message maintenant 😞

root@xxxx:~# badblocks -nvs -c 393216 /dev/sdq > /volume3/docker/sdq.log 2>&1 &

[7] 14661

root@xxxx:~# tail -f /volume3/docker/sdq.log

/dev/sdq is apparently in use by the system; it's not safe to run badblocks!

0 -

je viens de tester avec un nombre moins élevé et c'est pareil...

root@xxxxx:~# badblocks -nvs -c 196608 –b 4096 /dev/sdq > /volume3/docker/sdq.log 2>&1 &

[7] 3346

root@xxxxx:~# tail -f /volume3/docker/sdq.log

badblocks: invalid first block - /dev/sdq

0 -

j'ai 8go de ram sur mon nas

dont 3go d'utilisé donc je ne vois pourquoi cela pose problème...

je ferais un essais se soir au cas ou

0 -

je viens de débrancher le disque et je l'ai mis sur un autre port usb pour voir:

avec la commande (fdisk -l) j'obtient:

GPT PMBR size mismatch (239649 != 245759) will be corrected by w(rite).

Disk /dev/synoboot: 120 MiB, 125829120 bytes, 245760 sectors

Units: sectors of 1 * 512 = 512 bytes

Sector size (logical/physical): 512 bytes / 512 bytes

I/O size (minimum/optimal): 512 bytes / 512 bytes

Disklabel type: gpt

Disk identifier: 69CADB00-xxxxxDevice Start End Sectors Size Type

/dev/synoboot1 2048 67583 65536 32M EFI System

/dev/synoboot2 67584 239615 172032 84M Linux filesystem

Disk /dev/sdq: 9.1 TiB, 10000797794304 bytes, 19532808192 sectors

Units: sectors of 1 * 512 = 512 bytes

Sector size (logical/physical): 512 bytes / 4096 bytes

I/O size (minimum/optimal): 4096 bytes / 4096 bytes

Disklabel type: gpt

Disk identifier: 8F82D846-xxxx

0 -

Le volume 3 est correspond a un HDD du synology (pas de raid)

Et le dossier "docker" est un dossier partagé créé moi meme!

0 -

il y a 8 minutes, firlin a dit :

Bonjour totoleouf

Tu es sur que ton disque monter dans un boîtier usb est bien nommé sdq ??

Comme tu l’a spécifié dans ta commande ?

Envoyé de mon iPhone en utilisant Tapatalkoui oui il est dans son boitier usb au fesse du syno

et oui j'ai vérifié avec la commande (fdisk -l)

Disk /dev/sdq: 9.1 TiB, 10000797794304 bytes, 19532808192 sectors

Units: sectors of 1 * 512 = 512 bytes

Sector size (logical/physical): 512 bytes / 4096 bytes

I/O size (minimum/optimal): 4096 bytes / 4096 bytes

0 -

salut à tous,

j'ai suivi le tuto pour préparer un HDD de 10to.

il est branché en Usb3:

j'ai lancé la commande suivant :

badblocks -nvs -c 393216 –b 4096 /dev/sdq > /volume3/docker/sdq.log 2>&1 &

mais quand je veux suivre l'évolution avec la commande:

tail -f /volume3/docker/sdq.log

j'obtiens cela :

badblocks: invalid first block - /dev/sdq

ou est mon erreur?

merci,

0 -

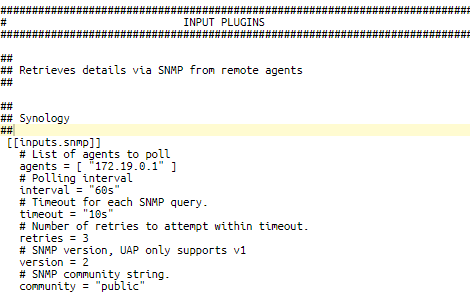

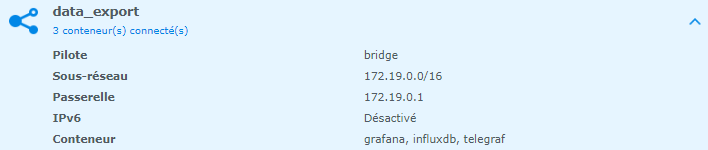

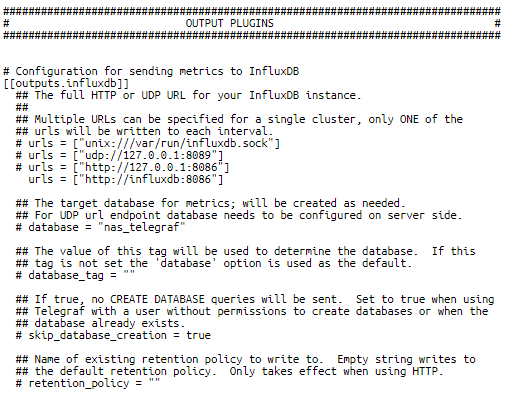

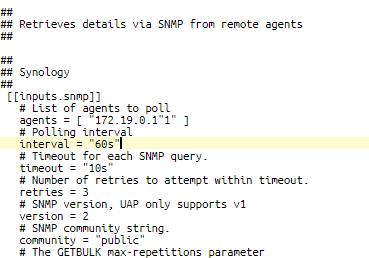

J'ai tout supprimé et repris du début.

Malheureusement, même résultat...

je pense que je fais mal les choses avec le fichier telegraf.conf .

notamment sur la partie suivante:

c) Il va falloir ajouter les infos relatives aux fichiers MIB de Synology, il suffit de copier ce qui est repris dans ce lien et le coller par exemple au début de la section "Input plugins"

Il faut cependant personnaliser les infos relatives à l'adresse IP du NAS et le nom de la communauté SNMP :il faut ajouter la partie qui est dans le lien ou remplacer la partie INTPUT PLUGIN du fichier .conf par ce qui donné dans le lien?

0 -

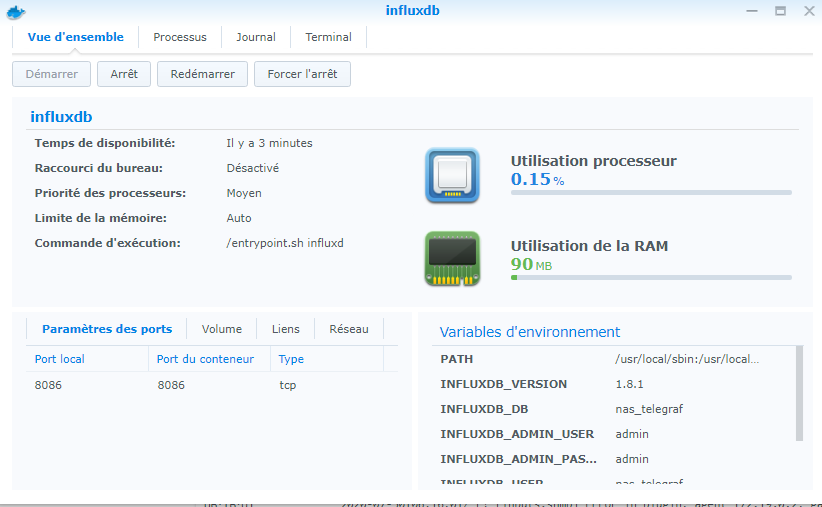

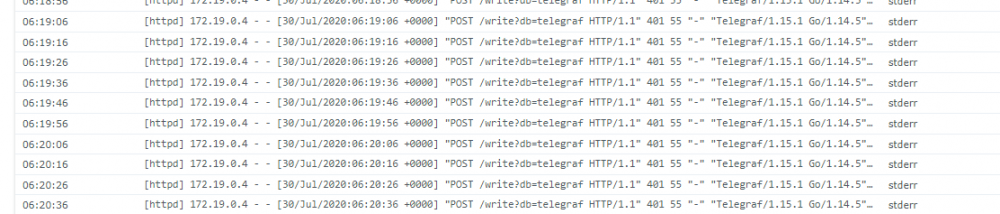

Il y a 3 heures, .Shad. a dit :

Erreur 401 c'est accès non autorisé, ça peut être des identifiants qui ne correspondent pas entre ce que tu as mis dans l'authentification http dans telegraf.conf et les variables d'environnement de création du conteneur influxdb.

j'ai beau reprendre le tuto du début et vérifier, j'ai bien laissé les identifiants et mot de passe "nas_telegraf" etc... tel qu'ils sont indiqués dans le tuto.

0 -

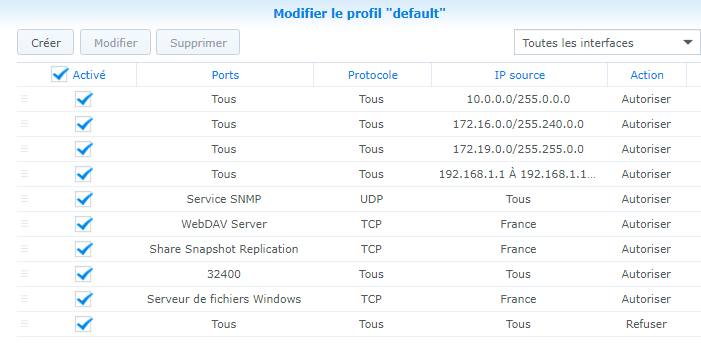

j'ai corrigé l'erreur dans le fichier .conf

et

vérifié dans mon parfeu le port 161 est bien ouvert:

et ajouter le réseau 172.19.0.0

Mais toujours l'erreur dans les logs telegraf

0 -

-

Le 02/08/2019 à 14:34, Superthx a dit :

@shadowking salut !!!

J'ai un probleme avec telegraf, dnas les log j'ai ceci :

2019-08-02T12:32:10Z E! [outputs.influxdb] when writing to [http://influxdb:8086]: 401 Unauthorized: authorization failed 2019-08-02T12:32:10Z E! [agent] Error writing to output [influxdb]: could not write any addressD'où cela peut venir ? Merci.

EDIT:

J'ai trouvé l'erreur.@+

salut j'ai suivi le tuto, et je suis bloqué au même problème que toi, quel était t'as solution?

0 -

Le 29/05/2020 à 10:14, unPixel a dit :

Pour aller plus loin, voici ma configuration actuelle pour Emby :

- Container Docker sur le DS918+ pour Emby (bientôt remplacé par un serveur plus performant).

- Stockage de 40 To bientôt supprimé (en cours de transfert des données)

- Stockage des métadata et des médias dans le cloud (Rclone avec chiffrement activé).

Avantages :

- Stockage illimité pour 11€/mois

- Données chiffrées donc pas de ban de la part du prestataire externe (Google Drive dans mon cas)

- Plus besoin d'acheter de disques durs. Les 10 To et plus ne sont ) pas donnés...

- Lancement d'un média aussi rapide que si il était stocké dans le serveur ou sur le réseau local.

Inconvénients :

- J'avais déjà les 40 To de sauvegardé dans le cloud mais avec Hyper Backup en mode sauvegarde chiffrée. Il faut que je renvoi tout en version Rclone chiffré !

- Chiffrement à la volée donc demande un peu de ressources CPU quand un utilisateur demande la lecture d'un média. Ex : 10% de CPU sur le DS918+ quand un client lance la lecture d'un média (hors transcodage si il a besoin).

- Si coupure internet, on a accès qu'aux données stockées en local ou dans le cache.

- Les gros médias (50 Go et plus) ne passent pas bien avec la mise en cache et le déchiffrement instantané. Ces médias restent donc en local pour moi.

stockage illimité pour 11€/mois?

je demande à voir, je suis septique

0 -

Le 13/04/2020 à 21:22, totoleouf a dit :

Je reviens suite à mon erreur d'autorisation de droit d'un dossier monter depuis un 2ém nas.

je remarque que dans PLEX quand je veux lire une vidéo qui est située sur le dossier monté, la vidéo mes environ 30s à ce lancer (en lecture direct).

Est-ce normal?

le dossier est monté en CIFS, faut-il utiliser une autre méthode de montage?

Je m'auto répond.

Sur le NAS 2, quand j'ai crée le dossier partagé "vidéo", sans faire attention la case "vérifier la parité des données" était cochée.

D'où le ralentissement...

J'ai monté un nouveau dossier partagé, et transféré mes séries.

Dans PLEX la lecture est de nouveau instantané !

PS: je fais le tour des erreurs 🤣, je vais devenir un pro Synology à force!

0 -

-

il y a 6 minutes, Einsteinium a dit :

oui les données ne sont pas chiffrés sur le nas, mais les données le sont certainement entre les deux nas, ce qui est inutile localement, désactive l'option et cela devrait être plus rapide.

A quel niveau je regarde dans les paramètres ?

Et sur quel nas?

0 -

Il y a 1 heure, Einsteinium a dit :

As tu aurais du le dire directement, donc ce n'est pas un problème de lecteur, tu n'aurais pas forcer le SM3 only, voir le chiffrement en prime ?

Désolé, je n'ai pas pensé à préciser.

Le dossier du second nas n'est pas chiffré.

Par contre je ne comprend pas ce que tu entend par SM3 only.

0

.png.6a01ac54a82f1bae6d136df4b25954f4.png)

.png.b3b6794269dee8dcef93b22e23840e30.png)

[TUTO] Préparation des disques avec Badblocks

dans Tutoriels

Posté(e)

il est neuf il sort de l'emballage... un peu dégouter! je vais demander le remplacement a l'identique c'etait sur amazon.de