Rechercher dans la communauté

Affichage des résultats pour « Web Assistant ».

-

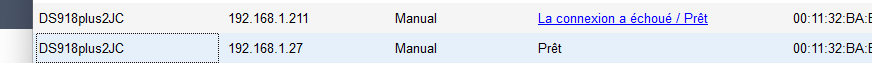

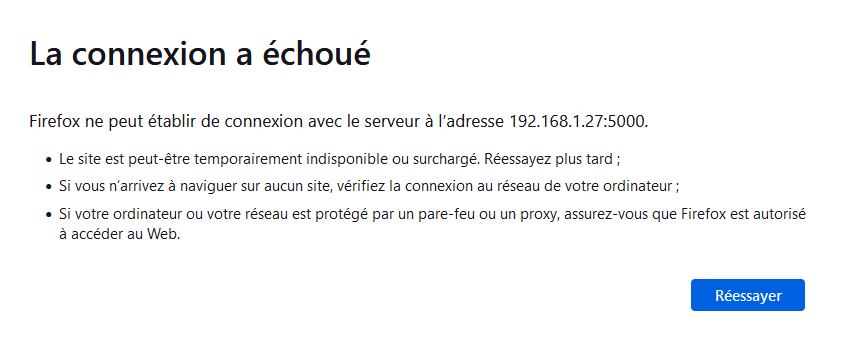

Salut, J'ai un DS918+ qui est reconnu sur le routeur FreePro. Reconnu avec l'assistant mais inaccessible.... Vous en pensez quoi ? Sur les 2 IP même résultat.... Ci dessous les screens. Merci pour votre aide

-