Classement

-

PiwiLAbruti

SynoCommunity28Points8795Compteur de contenus -

Mic13710

Les Modos27Points12320Compteur de contenus -

Lelolo

Les Modos12Points4124Compteur de contenus -

StéphanH

Membres11Points4718Compteur de contenus

Contenu populaire

Affichage du contenu avec la meilleure réputation depuis le 06/08/25 dans toutes les zones

-

[TUTO] [Docker - macvlan] Pi-Hole (V6)

Refonte du tutoriel pour la V6, amélioration du fichier compose et mise à jour des impressions d'écran.3 points

-

Les NAS n'apparaissent plus dans le voisinage réseau de Windows 11

… comme ça, tu utiliseras des systèmes obsolètes qui tomberont à la première faille exploitable. C'est vraiment un bon conseil… 😅2 points

-

[firmware migration] Installation du firmware Qnap (QTS) sur NAS Fujitsu Celvin via SSH

Installation du firmware Qnap (QTS) sur NAS Fujitsu Celvin via SSH Rappel: La majorité des serveurs NAS Fujitsu Celvin sont fabriqués par QNAP (Produits OEM ou Co-branding) ce qui signifie que les modèles Fujitsu sont des versions reconditionnées de modèles QNAP, avec un design légèrement modifié (logo, couleur) et un firmware spécifique. Le firmware de Fujitsu (Celvin OS) est très proche de celui de Qnap (QTS). Fujitsu assure la totalité des services comme pour tous produits Fujitsu: Support client, mise à disposition de mises à jours et d'applications qui lui sont propres, même si elles sont identiques à celles du Qnap. Parfois Fujitsu ne fait que changer le nom de l'application. Fujitsu dispose de ses propres serveurs pour les mises à jours et pour "app center". Pourquoi migrer de Fujitsu à Qnap? Fujitsu a cessé le support des NAS CELVIN. Par exemple les NAS sortis entre 2009 et 2012 ne sont plus pris en charge par Fujitsu depuis 2018. En 2025, Fujitsu a arrêté le serveur d'app center, Plus aucune application n’apparaît dans le magasin d'applications. La seule manière d'installer des applications est l'installation manuelle. En 2020 Fujitsu et Qnap ont décidé que Qnap poursuive le support pour les NAS concernés. Une fois le NAS migré, il est pris en charge par Qnap et bénéfice de tous les services et supports de Qnap. La migration permet de bénéficier des mises à jours de sécurité du firmware Qnap. Elle permet de retrouver un app center fonctionnel et permet d'installer les anciennes applications qui y sont proposées. Même chez Qnap, pour le vieux matériel certaines applications ne bénéficient plus de mise à jours, ce qui limite de l'utilisation des applications officielles. Mais beaucoup d'applications non officielles sont disponibles en paquets (qpkg), notamment sur le site myqnap.org. L'intérêt de la migration est essentiellement d'obtenir les mises à jours de sécurité de QTS. Pour bénéficier d'applications récentes, l’utilisation d'applications tiers est la meilleurs solution. Comment migrer? En accord avec Qnap, Fujitsu propose pour certains modèles une méthode automatisée par l'installation d'un paquet officiel (qpkg) qui permet d'installer le firmware QNAP (QTS) à la place de celui de Fujitsu par l'interface de gestion du NAS comme si on faisait une simple mise à jour. Le paquet modifie tout simplement le nom du modèle du NAS pour que la mise à jour vers le firmware équivalent de chez Qnap fonctionne Les modèles concernés sont les suivants:Q805, Q905, QR806, QR1006, QE705, QE805, QE707, QE807. L'autre moyen de migrer est d'utiliser la méthode manuelle par SSH présentée ici. Pour les modèles qui ne bénéficient pas de la méthode automatique, SSH est la seule méthode possible. Migration manuelle par SSH: Prérequis: Avoir un NAS fonctionnel: Avec au moins un disque dur configuré dans le NAS, qu'il soit accessible depuis votre PC avec l'interface de gestion Web et avec accès aux dossiers partagés depuis votre PC. A savoir: Les systèmes d'exploitation des NAS Qnap (et Fujitsu), sont basés sur un noyaux Linux. Vous y retrouverez donc des programmes et structures similaires. Il est même possible d'installer une distribution Linux comme Debian sur le NAS. La méthode SSH utilise une procédure d'installation manuelle du firmware fournie par Qnap. Elle est réservée aux utilisateurs avertis, car elle permet d'installer un firmware dont le nom de modèle ne correspond pas à celui installé sur le NAS. Il faut être sûr d'avoir le firmware du modèle Qnap correspondant à votre NAS Fujitsu. Si vous installez le mauvais firmware, vous pouvez rendre votre NAS inutilisable! Vérifiez bien sur le site de Qnap si les caractéristiques sont les mêmes que votre modèle Fujitsu. Après installation, le nom de modèle de votre NAS sera celui de Qnap, il sera reconnu comme tel par Qnap et app center proposera les applications compatibles avec votre modèle. Vous trouverez des ressources (Aides - How to) en français sur le site de QNAP https://www.qnap.com/fr-fr/how-to/search Il existe un wiki plus complet en anglais https://wiki.qnap.com/wiki/Main_Page Procédure: Télécharger le firmware QNAP correspondant à votre modèle. Le firmware se présente comme une image de disque (.img) qui est compressée au format zip (.zip): Allez dans le Centre de téléchargement QNAP: https://www.qnap.com/fr-fr/download Sous "Type de produit", sélectionnez "NAS / Extension". Sous "Baie", sélectionnez le nombre de baies de lecteur pour votre NAS. Sous "Modèle", sélectionnez le nom du modèle Qnap correspondant à votre NAS Fujitsu. Dans la section "Télécharger les éléments", cliquez sur "Système d’exploitation". La liste qui apparait est celle du firmware (Système d'exploitation) avec le plus récent en haut. Téléchargez le fichier en cliquant sur le lien dans la colonne "Lien de téléchargement". Décompressez le fichier zip. Copiez le firmware dans le dossier Public du NAS: Vous pouvez renommer le ficher image (.img) que vous venez de décompresser. J'ai effectué la migration d'un Q703. Je prends donc ce modèle comme exemple. J'ai renommé le ficher image en "TS-221.img". Remplacer "TS-221.img" par le nom que vous avez choisi dans le reste du tutoriel. Par l'explorateur de fichiers de votre système, copiez le fichier image dans le dossier Public du NAS. Autoriser la connexion SSH dans le NAS: SSH, pour Secure Shell, est un protocole de communication réseau qui permet d’établir une session chiffrée entre deux machines, typiquement un client et un serveur. Si la connexion au NAS par SSH n'est pas activée, vous devez l'activer soit par l'interface du NAS, soit avec Qfinder. Si besoin aller voir l'aide QNAP: https://www.qnap.com/fr-fr/how-to/faq/article/comment-acc%C3%A9der-%C3%A0-mon-nas-qnap-en-utilisant-ssh Accédez à votre NAS avec SSH: Vous devez ouvrir une console (un terminal) prenant en charge SSH. Sous MacOS et Linux, cette fonctionnalité est généralement activée par défaut. Sous Windows, elle n'est pas toujours disponible. Sous Windows 10 ou 11, Vous devez activer le "client OpenSSH" dans les paramètres de Windows. Si vous ne savez pas comment faire, vous trouverez des tutos sur internet. Une fois fait, les consoles de Windows prendrons en charge SSH. Il vous suffit alors d'ouvrir une console, soit par l’invite de commandes Windows (CMD), soit par PowerShell. Sinon, vous pouvez installer un programme comme "Git Bash" ou "PuTTY". La page d'aide indiqué précédemment montre la méthode pour MacOS et pour Windows avec "PuTTY". Installer le firmware avec l'image: Dans la console que vous venez d'ouvrir, saisissez les commandes suivantes et terminez par la touche "Enrtée" pour validez (exécutez) les commandes. Vous pouvez les copier-coller. N'oubliez pas d'adapter les valeurs à votre cas (adresse IP du NAS, nom de l'image). Code: ssh Code: ssh admin@ipRemplacez « ip » par l'adresse IP de votre NAS. Le système vous demande ensuite le mot de passe. Celui par défaut est « admin ». [Par cette commande, vous vous connectez au NAS à distance en vous identifiant comme l'utilisateur "admin", comme vous le faites lorsque vous accédez à l'interface de gestion du NAS avec votre navigateur, mais ici vous le faites en ligne de commande par le protocole SSH.] Saisissez ensuite les commandes suivantes: Code: mkdir /mnt/HDA_ROOT/update[Cette commande créé le répertoire "update" dans le répertoire HDA_ROOT.] Code: rm -rf /mnt/update[Cette commande efface le contenu du répertoire "update" au cas où il ne soit pas vide.] Code: rm -f /tmp/update_process[Cette commande efface un éventuel fichier temporaire qui serait resté d'une précédente mise à jour] Code: ln -sf /mnt/HDA_ROOT/update /mnt/update[Cette commande créé un lien symbolique entre les deux emplacements.] Code: /etc/init.d/update.sh /share/Public/TS-221.img[Cette commande lance le "script" (ou programme) d'installation du firmware (update.sh) et lui indique ne nom de l'image ("TS-221.img" dans mon cas) et son emplacement (dossier Public du NAS).] Le processus d'installation se déroule et des informations apparaissent dans le terminal tout au long du processus. Le processus peut prendre un certain temps. Vous verrez apparaitre le nom du modèle d'origine du NAS, Q703 dans mon cas : "model name = Q703". Une ligne plus bas vous indiquera le nouveau nom de modèle qui sera attribué au NAS: TS-221 dans mon cas. Si tout se déroule correctement, la procédure se termine par le message : « Mise à jour terminée ». Saisissez ensuite : Code: rebootAprès le redémarrage, qui est assez long, vous trouverez la nouvelle interface sous QTS en vous connectant au NAS avec votre navigateur ! Dans mon cas, tout était intact : mes applications et mes données étaient toujours présentes. [Pour information, après la migration j'ai voulu faire une réinitialisation sans formatage des disques, Mais lors du redémarrage, le système m'a forcé à réinstaller le firmware. Il suffit de sélectionner le fichier image (TS-221.img dans mon cas) et de laisser le processus se faire.] Il est alors possible de créer un compte sur le site de QNAP, d'enregistrer le NAS et d'utiliser tous les services QNAP. N'hésitez pas à partager vos expériences de migration de votre NAS ou à les publier sur le forum! Je suppose que cette méthode fonctionne avec tous les modèles QNAP, car la documentation QNAP ne mentionne aucun modèle particulier. - Page de l'aide du site QNAP pour la mise à jour par SSH: Comment mettre à jour manuellement le firmware par SSH ? - Page du site Wiki QNAP pour la mise à jour par SSH: : Manually Updating Firmware Au cas où votre NAS ne démarre plus: Récupérer un NAS ARM ancienne génération Récupérer un NAS X86 ancienne génération2 points

-

Turbobit - fichier Host

2 pointsSalut, J’ai fait un test avec AllDebrid : il y a un fichier host. Tu renseignes ton compte avec une clé API qu’il faut générer sur le site, et ensuite, quand tu veux faire un téléchargement, tu mets n’importe quel lien dans Download Station et ça télécharge comme par magie. C’est vraiment trop bien, et en plus avec des sacrées vitesses : j’arrive presque à 300 Mo/s2 points

-

DS218+ et DSM 7.3.2

2 pointsIl n'y a plus de mise à jour automatique des versions mineures de DSM pour les modèles des séries ´16 à ´19 depuis DSM 7.2. Elles ne peuvent donc être faites que manuellement.2 points

-

[Résolu]Après installation 7.3, la synchro Active Directory ne fonctionne plus correctement sur les groupes d'utilisateurs

merci pour la réponse. C'est fait et nous avons eu la réponse. Effectivement il s'agit d'un bug sur la 7.3 (depuis la 1ere version). Un correctif est prévu (quand ?). En attendant pour résoudre le problème nous avons découvert qu'il ne fallait pas utiliser la planification de synchronisation de l'AD sur le NAS. C'est ce que nous a confirmé Syno. Dommage que ce genre de bug majeur ne soit listé quelque part, avec le contournement possible. Cela éviterait 2 jours de travail avant de comprendre et de trouver nous-mêmes la solution.2 points

-

DSM 7.3 en vue

2 pointsBonjour, Je viens de voir que dsm 7.3 est en vue. Ce sera la dernière mise à jour pour mon DS 218+ 😞2 points

-

Plusieurs nas derière une seule IP publique pour synology drive

Autre solution : en IPv6, chaque NAS a sa propre adresse IP publique, et est donc adressable sans souci, sur tous les ports.2 points

-

[TUTO] [Docker - macvlan] Pi-Hole (V6)

Salut @.Shad., Le problème avec les serveurs DNS c'est que leur hiérarchie n'est pas respectée. Le client peut faire appel à n'importe quel serveur de la liste. Si le DHCP distribue plusieurs IP DNS, il vaut mieux que ces serveurs résolvent les requêtes de la même manière. Je suis plutôt pour une deuxième instance pi-hole (ce que j'ai), ou bien à la limite passer par le serveur DNS du NAS avec une zone correctement paramétrée. Surtout pas d'autres serveurs externes qui sont incapables de résoudre les adresses locales.2 points

-

[TUTO] [Docker - macvlan] Pi-Hole (V6)

Hello, j'ai aussi fait la migration il y a quelques semaines et ça s'est très bien passé. Je vais essayer de trouver le temps de mettre à jour le tutoriel, je devrais retrouver des disponibilités à partir de fin juin...2 points

-

[Résolu]Erreur liée à la confidentialité / Certificat

Deux solutions : soit vous indiquez le nom de domaine et le port du service que vous voulez atteindre : https:\\xxx.synology.me:<Numéro du port>, soit vous paramétrez le reverse proxy qui permet d'associer un nom de domaine à un service : par exemple https:\\audio.xxxx.synology.me Dans le premier cas, il faut ouvrir dans le routeur tous les ports des services que vous voulez utiliser et les diriger vers le NAS. Dans le deuxième, vous ouvrez uniquement le port 443 (https) que vous dirigez vers le NAS. Dans tous les cas, il faudra autoriser l'accès aux dit services dans le parefeu s'il a été activé (fortement conseillé). Pour le reverse proxy, vous trouverez un tuto dans la section des tutoriels.1 point

-

Attention : Synology désactive discrètement le transcodage matériel sur ses NAS !

oui apres, les clashes de ces derniers mois sont justififiable bien que penible, les disques dur par exemple le faite de limité a certain model, simplifie grandement les erreur et les crashs possible surtout dans un environnement raid, j'en ai fait les frais par le passé avec des disques pas prevu pour du raid... comme beaucoup de particulier (et je l'ai fait moi même) veulent prendre des disques le moins cher possible, c'est un cauchemar a garder le tout stable (entre les disques eux même et le fw c'est vite le boxon), donc en somme c'est en grande partie de notre fautes qu'on en est la aujourd'hui, avec l'experience je ne prends que des disques de marque certifier nas (seagate) ou entreprise et les prix tabasse.... (j'en suis a mon 3ieme rein de vendu haha) apres je prends des nas 12 baie donc bon ^^ maiq que synology ai fait se choix pour limiter les risques et prendre des sous au passage en rebrandant des disques de marque n'est pas deconnant ca reste une entreprise qui veut faire des benef, on vie pas dans le mon des bisounours ^^ concernant le choix de videostation, pour avoir developpé moi même une solution video que j'ai utilisé pendant des années , c'est un enfer a maintenir, entre les provider d'info qui change leurs api, les licences qu'il faut payer pour les utiliser, les format divers des videos a analysé, les souci de performance... et le faites que videostation était bancale, ca faisait le minimum pas beaucoup de gens devait réélement l'utiliser. même chose la desactivation du transcodage materiel outre les coûts de liscences pour le h.265 a payer par appareil et par an, tout les nas n'avait pas de igpu enfaite quand on regarde le catalogue il y en a que 1 ou 2 qui ont un igpu donc pour tout les autres le moindre transcodage c'est un cpu a 100% a coup sur, du coup ils ont du se tapper des reclamatiosn a tout va, et c'est difficilement compréhensible pour le client de comprendre que sont nas a 2k fait pas la meme chose qu'un nas a 250€, donc dans la logique c'est plus simple de tout viré que de devoir géré cette specification pour chaque model, et ca permet de faire des economie annuel consequente et de reduire sur le long terme le support pour ca. apres le plus dérangeant est que il ont ouvert la porte a se genre de pratique, faut voir ou il vont s'arreter, la boite de pandore a été ouvert, et c'est stressant pour l'avenir, il sont en train de brisé la confiance.... donc a voir avec le temps, pour moi ca sera très difficile de me passer de synology, comme evoqué les autre solution on du retard, et beaucoup de chose ne sont pas presente et donc bloquante pour moi. apres voyant les restrictions de puissance sur mon syno (DS2419+) j'ai fait le choix de mettre mon plex sur une machine windows (mini pc) a coté juste pour ca, mais c'est un luxe que j'ai pu me permettre. et tout ce que je peux mettre en docker je le met en docker, du coup a chaque mise a jour de synology je sers moins les fesse 😛 Petit point concernant les concurrents, le seul qui pourrait etre a l'ecoute de ses utilisateurs c'est ugreen car c'est un petit nouveau, mais leurs solution c'est le minimum syndicale, ca ne fait pas 1/6 pas rapport a se que propose syno et on ne connais pas la fiabilité sur le long terme.... pour les autre le plus proche est qnap, mais ca reste plus limité et c'est devenu la même boite noir que synology, alors pour pouvoir les contacter et les faire evolution va falloir se lever tot avant qu'il nous ecoutent... surtout que le marché des nas c'est ouvert ces derniers années, il y a plus d'utilisateur lambda que de bidouilleurs et c'est aussi a cause de cela que nos voix sont de moins en moins entendu, car il en ont marre du support de l'utilisateur lambda, du coup il sous traite le support, du coup les remontés des utilisateurs experimenter n'arrive plus au dev, c'est se qui c'est passez avec synology ces dernières années après je dis nullement qu'ils font les bon choix, moi ca m'embête pour l'avenir et je suis pas serain hein, j'essai de rationnalisé 😛1 point

-

Attention : Synology désactive discrètement le transcodage matériel sur ses NAS !

Hello, ca commence a sentir mauvais tout ça, ca sent le changement de direction foireuse… j’utilise des nas syno dans des versions qui n’on pas d’igpu (besoin de stockage) et j’utilise essentiellement le sso, docker (meme si leurs sur couche graphique est bancale) et la partie reverse proxy et certificat… donc pour le moment je ne suis pas vraiment impacter par leurs changement… mais si ca continue ont va voir disparaitre audio station, photo… en gros tout ce qui est multimedia… même si ils se tourne vers le pro ca reste du petit pro, donc du mal a voir l’intérêt de perdre leurs client grand publique… stratégie plus que douteuse, a moins que l’entreprise se porte mal… en attendant j’ai fait un check coté concurrence et il manque beaucoup de chose, qnap est le plus avancé mais il ya pas mal de chose qui manque. synology est ce qu’il est grace a la communauté d’ou sont avance sur la concurrence, donc devoir changer ca va etre un bon gros retour en arrière sur les fonctionnalités, surtout que une grande distance entre les users et les entreprises c’est mise en place ces dernière années, du coup il est loins le temps ou on pouvait être en contacte avec les dev de synology, le sav est devenu la cata avec des incompetents.. et c’est pareil partout, donc pour réussir a faire évoluer les choses avec un nouveau fabriquant ca va être compliquer. il y a les solutions open comme l’a mentionné @rodo37, mais la c’est le materiel, la conso, les problemes ou on sera seul, risque de crash et j’en passe qui vont poser souci, réussi a faire un serveur nas fiable, pour du h24 7j/7 qui consomme pas comme une tesla en pleine charge, qui est capable de reparer un raid, gerer les disques, les backups, la gestion des onduleurs, la secu et j’en passe1 point

-

[Résolu]Installation second disque dur

Oui, c'est le principe. MAIS cela ne dispense absolument pas d'une sauvegarde...1 point

-

[Résolu]Installation second disque dur

Le temps que le deuxième disque soit ajouté, tu peux lire le tutoriel sur la sécurisation réseau : https://www.nas-forum.com/forum/topic/77493-tuto-pas-à-pas-sécurisation-du-nas-pour-dsm-7/#comments1 point

-

[TUTO] Certificat Let's Encrypt avec acme.sh & api Ovh en Docker (DSM6/7) (Update 07/09/22)

Non dans 2 mois. Le certificat valable 3 mois est renouvelé au bout de 2 😉1 point

-

Mon NAS DS1515+ fait des bip sans raison

Ou bien un détecteur de fumée à proximité dont la batterie est en fin de vie. Ou tout autre chose mais certainement pas le NAS s'il est débranché de son alimentation.1 point

-

[TUTO] Certificat Let's Encrypt avec acme.sh & api Ovh en Docker (DSM6/7) (Update 07/09/22)

@CMDC, effectivement, je parle bien du container, pas du script qui est de toute manière mis à jour automatiquement par lui-même à chaque lancement si besoin. Ceci dit, malgré les mises à jour régulières du container, je n'ai pour l'instant observé aucun blocage sur des NAS encore sous Docker qui utilisent des versions très anciennes.1 point

-

[TUTO] Certificat Let's Encrypt avec acme.sh & api Ovh en Docker (DSM6/7) (Update 07/09/22)

Si : Le script qui suit supprime et recrée le container. Perso je n'ai jamais mis en oeuvre cette partie du tuto qui a été écrite avant l'arrivée de Container Manager. Je n'adhère pas du tout au principe du lancement journalier qui est un peu beaucoup too much. Je préfère aller de temps en temps sur Container Manager et lancer la mise à jour manuellement. La version n'a pas vraiment d'impact sur la création du certificat. Pour info, j'ai des NAS qui n'ont pas de mise à jour du container et qui tournent sans problème avec des anciennes versions.1 point

-

[Résolu]Au secours! ( tout simplement )

Update: c'est tout bon! Ça a été un peu fastidieux car l'IP a changé et j'ai du jongler entre mon smartphone et le pc ( je ne sais pas pourquoi, mais l'interface admin après Reset ne s'affichait que sur le navigateur web de mon tel, et le PC affichait une erreur de connexion ). Bref tout est rentré dans l'ordre, mais je me demande quand même qu'est ce qui a pu générer ce souci? Merci ✌🏻1 point

-

[Résolu]Au secours! ( tout simplement )

Installe synology assistant sur ton pc (disponible en téléchargement chez synology). Désactive le parefeu de ton pc (quelques minutes) et regarde ce qu'il trouve sur ton réseau. J'ai testé chez moi, le find.synology.com (qui se lance sur le navigateur internet) ne trouve pas mon synology. Mais le logiciel synology assistant oui (à condition que je coupe le parefeu Eset bien sur).1 point

-

[Résolu]Au secours! ( tout simplement )

Bonjour, Si tu as un antivirus/protection internet désactive le parefeu temporairement (quelques minutes) pour voir si synology assistant voit ton syno. J'ai Eset sur mon pc, et si je ne désactive pas le parefeu Eset, synology assistant ne voit aucun synology sur le réseau... @+1 point

-

[Résolu]Au secours! ( tout simplement )

À première vue, je dirais que le compte utilisé n'a pas (ou plus) les droits administrateur. Un simple reset rétablirait le compte admin par défaut, ce qui permettrait de récupérer l'accès au Panneau de configuration pour vérifier ce qu'il en est.1 point

-

Ubiquiti

1 point

-

[Résolu]Download station - Freebox + BT

Probléme résolu... J'ai constaté que le probleme n'était pas seulement download station mais tout ce qui concerne le NAS losqu'il utilise internet comme par exemple le gestionnaire de package.. jai activé le ssh et je n'arrivais pas a connecter a ping 192.168.1.1 ni google . j'ai passé la config réseau en auto sur le NAS et jai découvert que La paserelle par défaut de la FREEBOX est 192.168.1.254 et non 192.168.1.1 ...1 point

-

[Résolu]Download station - Freebox + BT

@pinoufUne question download station, ça se pose dans le fil du même nom. --> Je déplace, mais merci d'être attentif !1 point

-

[Résolu]Message : Vous n'avez plus accès à ce serveur -> Non autorisé

http://<iplocale>/web:32400 doit t’afficher l’interface Plex habituelle …1 point

-

[Résolu]Message : Vous n'avez plus accès à ce serveur -> Non autorisé

il faut de nouveau réclamer le serveur … à voir ici. J'ai pu restaurer un serveur sur les deux miens (il faut être sur le LAN de chaque serveur)1 point

-

Inversion des disques durs sur deux nas

Bonjour @Jeff777, Non, tu ne peux pas monter un disque, plus petit que celui existant dans le volume actuel. Dans ton cas le disque le plus petit c'est 12To sur le DS220+ et sur le DS218+ c'est 8To. Dans un cas tu peux remplacer les disques de 8to par des 12to par contre dans l autre cas cela ne va pas fonctionner. Tu vas devoir repartir de zéro avec une sauvegarde du DS220+ au moyen d'Hyperbackup https://kb.synology.com/fr-fr/DSM/tutorial/How_to_migrate_between_Synology_NAS_DSM_6_0_and_later Ensuite tu sais que le fait de reconstruite un volume tu n'es pas à l'abris de souci, même si je te le souhaite pas.1 point

-

Bonjour à tous.

1 pointC’est rassurant, quelqu’un de ma génération 😁 1947 itou on devrait arriver à s’entendre 😀1 point

-

Impossible de DL un torrent

1 pointC'est un ban imposé par l'ARCOM aux serveurs DNS des gros FAI, et ça existe depuis des années. Aujourd'hui, l'ARCOM est plus occupée à bloquer les sites de streaming illicites. Et même sans parler de contourner ces blocages, utiliser des serveurs DNS autres que ceux des FAI est fortement conseillé pour bloquer les menaces en lignes, publicités, traqueurs, … : En voici quelques-uns en vrac : Quad9 (CH) : https://quad9.net/fr/service/service-addresses-and-features/ AdGuard (CY/RU) : https://adguard-dns.io/fr/public-dns.html > Rubrique Les adresses de nos serveurs > DNS brut DNS4EU (CZ) : https://www.joindns4.eu/for-public#resolver-options Il faut prendre le temps de regarder les cibles de blocage de ces services afin de trouver celui qui convient le mieux. Ils proposent différents serveurs DNS selon ce qu'on souhaite bloquer.1 point

-

Quels disques de 16 to/ 18 to ?

1 pointMais c'est bien le cas. Si la migration de disques est possible (groupe de stockage contenant DSM), la création d'un nouveau groupe de stockage sur un NAS '25 nécessite des disques Synology ou des disques tiers certifiés par Synology. Sachant qu'aucun constructeur tiers n'a pour l'instant fait certifier ses disques, seuls les disques Synology sont compatibles.1 point

-

Une histoire de gâteau d'anniversaire...

6 ans c'est déjà bien au delà des standards donnés par les constructeurs qui sont plutôt autour des 2-3 ans. Il ne faut pas se fier aux tests effectués par l'UPS. Ils ne durent que quelques secondes ce qui ne sollicitent pas la batterie suffisamment longtemps pour connaître son état réel. Rien ne vaut un test périodique (tous les 6 mois ou au moins 1 fois par an) sur une charge significative et connue comme par exemple une lampe halogène, l'UPS déconnecté de la charge habituelle (NAS, routeur, PC, switch, etc..). On vérifie l'autonomie en fonction de la puissance de la charge et celle de l'UPS et du temps de fonctionnement à pleine charge donné par le constructeur. Ca ne garantit pas que l'UPS tiendra la charge à la prochaine coupure (la batterie peut lâcher à tout moment), mais au moins on vérifie que la batterie et l'UPS sont OK au moment du test. Et si la batterie est limite lors du test, mieux vaut alors la changer à titre préventif.1 point

-

Accès en écriture depuis iPadOS 18.3

Au fait, merci pour cette info … je désespère qu’Apple implémente cela un jour …1 point

-

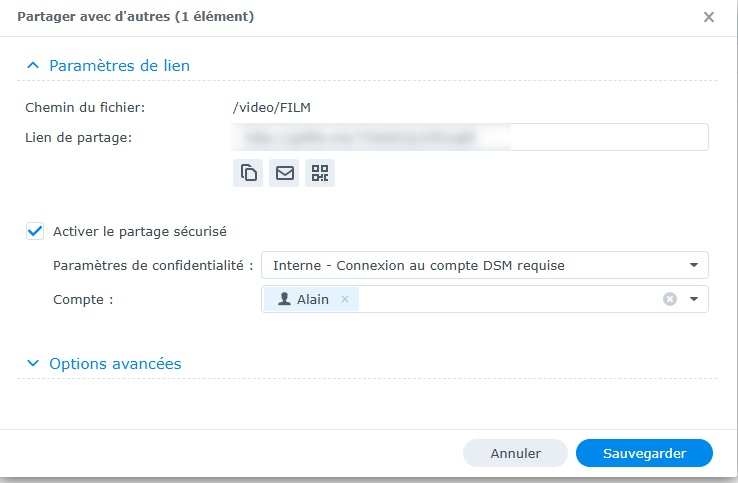

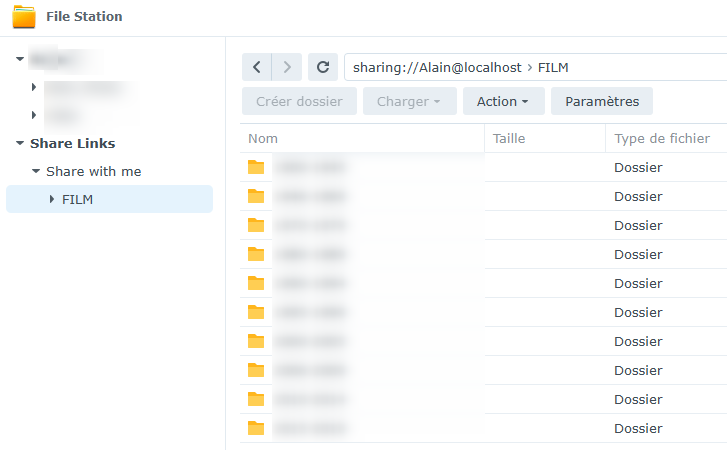

Partager des répertoires

1 pointBonjour @cubitus_syno Une solution très simple pour un partage en lecture seule. Dans File Station clic droit sur le dossier que tu veux partager > Partager Lorsque 'Alain' se connecte dans File Station il voit ça : Sous 'Share Links' il aura accès au répertoire choisi et aux sous-répertoires. Pour supprimer le partage, dans File Station > Outils > Gestionnaire de liens partagés1 point

-

Règles pare-feu - HELP

1 point

-

Règles pare-feu - HELP

1 point

-

Règles pare-feu - HELP

1 pointSincèrement, le blocage des pays indésirables t’évitera déjà 80% des tentatives non souhaitées. et je pense que ce blocage par pays est mixte v4 v6.1 point

-

Choix de Camera avec détection d'intrusion et enregistrement sur le NAS pour une Alarme

La caméra fonctionne 24/24 ou selon les plages horaires que vous décidez. L'enregistrement se fait la aussi comme bon vous semble : en continu, sur détection et selon les critères que vous définissez (plages horaires, présence). La détection de mouvement et d'intrusion se fait soit par la caméra, soit par le NAS. Toutes les caméras ne se ressemblent pas, certaines offres des possibilités de détection que d'autres n'ont pas et toutes les possibilités des caméras ne sont pas toujours intégralement retransmises sur le NAS. Le NAS a 2 licences gratuites. Si vous voulez plus de caméras, il faut acheter des licences supplémentaires.1 point

-

Synology Office - Édition en mode hors ligne sur Windows

Avez-vous essayé ? Sinon, je n'ai pas de solution à vous proposer. Perso, je n'aime pas du tout Synology Office : trop limité. Je travaille avec Microsoft office mais surtout avec VBA et malheureusement il n'y a pas d'équivalent. Je ne vois pas du tout l'intérêt de travailler sur un tableur à partir du navigateur. Autant utiliser une application dédiée aux tâches office, il y en a pléthore gratuites et de très bonne facture, et de passer par synology drive pour pouvoir retrouver les fichiers créés sur tous les clients. Je travaille comme ça depuis des années et ça me convient tout à fait.1 point

-

Comment redémarrer automatiquement après extinction automatique à cause de fortes températures ?

1 pointA mon avis, si le NAS s'éteint pour une élévation de température c'est que soit il est sale et il faut l'ouvrir pour le nettoyer (les ventilos, ce n'est pas suffisant), soit il chauffe parce qu'il n'est pas bien ventilé ou entouré de sources de chaleur, soit la pièce où il est installé est trop chaude, soit c'est une combinaison de tous ces facteurs. Et donc s'il s'éteint à cause de la température, il me semble tout à fait normal qu'il ne se rallume pas automatiquement car cela ne servirait à rien tant que le problème de surchauffe n'est pas résolu et le rallumer pourrait même à terme nuire au NAS. De mon point de vue, vous devriez plutôt chercher la cause que de tenter de contourner une protection.1 point

-

laurentia29

1 pointBonjour, utilisateur de longue date d'un DS214se qui a récemment rendu l'âme après plus de 10 ans de bons et loyaux services, j'ai opté pour un DS223J que j'ai équipé avec 2 disques WD RED de 2To, ce qui suffit à mon usage qui le partage avec 2 PCs. Je suis toutefois confronté à un petit soucis que je n'avais jamais expérimenté auparavant : désinstaller un paquet devenu inutile (section surveillance station). Merci.1 point

-

[TUTO] [Docker - macvlan] Pi-Hole (V6)

L'intérêt c'est que si tu redémarres ou éteins ton NAS, l'autre Pi-Hole prenne le relais car il sera défini en DNS secondaire. Aucun intérêt à héberger deux instances sur un même hôte. @Mic13710 Je voulais dire dans le cas où il n'utilise que des DNS publiques. Sinon effectivement, il faut que les zones DNS soient équivalentes pour un comportement consistent en cas de résolution locale.1 point

-

[TUTO] [Docker - macvlan] Pi-Hole (V6)

Je ne sais pas s'il est possible d'avoir 2 pi-hole sur un même NAS. Mes pi-hole sont sur 2 Rasp, un sur chaque site (voir ma signature), les deux sites étant reliés via Site Magic (Ubiquiti) qui est basé sur wireguard. J'ai en tout 4 adresses privées locales pour mes serveurs DNS, les 2 pi-hole plus celles des NAS sur lesquels j'ai des serveurs DNS locaux. Ainsi, quel que soit le serveur interrogé, les adresses locales sont bien résolues localement. Pour le Rasp, un V2 est plus que suffisant. J'ai un V2 et un V3 pour pi-hole.1 point

-

[TUTO] [Docker - macvlan] Pi-Hole (V6)

Bonjour, J'ai mes deux pi-holes comme dns du dhcp freebox mais effectivement si je remplace le deuxième par cloudflare par exemple, je retrouve de temps en temps des pubs même si mon premier pi-home fonctionne.1 point

-

[TUTO] [Docker - macvlan] Pi-Hole (V6)

Est-ce que tu parles des DNS du routeur lui-même ? ou des serveurs DNS envoyés par le serveur DHCP du routeur ? Je recommande de NE PAS mettre l'IP de Pi-Hole comme serveur DNS du routeur, uniquement des DNS upstream comme DNS0.eu, DNS4.eu, FDN, Quad9, etc... Si tu parles des DNS distribués par le serveur DHCP, oui tu devrais ajouter d'autres serveurs DNS, ou créer une 2ème instance de Pi-Hole sur une autre machine, et envoyer les deux IP via le serveur DHCP.1 point

-

L'agent Windows de Active Backup for Business ne fonctionne plus

Bonjour Pour ma part cela fonctionne chez moi par contre je ne suis pas sur d'avoir la même configuration que vous. Je m'explique: J'ai un certificat dédié à ça et il est gère par active backup, ma version est là 2.7.1-13235 Et le Windows est 10 build 19045 J'ai aussi la sauvegarde d'un serveur Linux et cela fonctionne bien aussi1 point

-

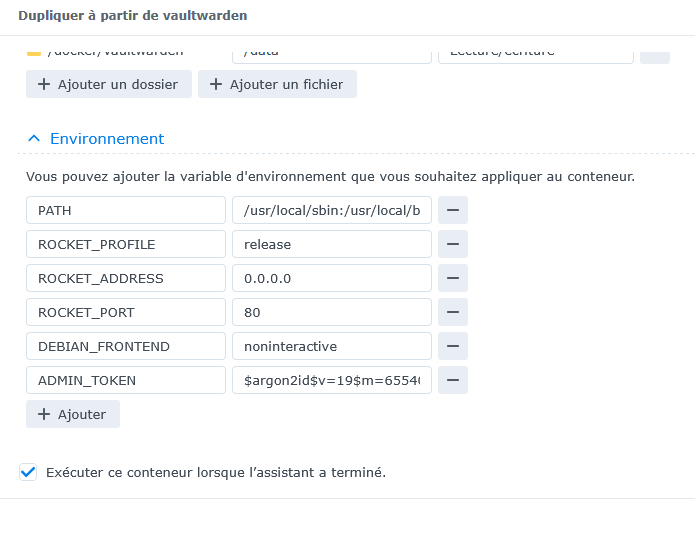

[Résolu]VaultWarden Activation de la page d'administration

1 point

-

[DS415Play] Disques durs HS à répétition

La liste n'est plus mise à jour car il s'agit d'un ancien modèle. Et les disques ne sont plus commercialisés pour bon nombre d'entre eux. Les deskstar sont des Hitachi. Ce sont en général de très bons disques mais depuis leur rachat par WD, j'aurais tendance à penser que les gammes s'harmonisent.... Les anciens NAS sont assez tolérants sur les disques, beaucoup plus en tout cas que les derniers modèles. Je ne peux que vous suggérer de vous tourner vers des disques qui sont compatibles avec des NAS séries J ou standards plus récents que le votre. Et surtout, ne prendre que des disques en techno CMR (pas de SMR !).1 point

-

HTTPS & certificats let's encrypt

Pour que ça fonctionne avec un nom de domaine au travers de wireguard ou de n'importe quel autre VPN, il faut qu'il y ait une résolution locale de l'URL et un reverse proxy pour diriger la requête vers le service demandé, ici votre application docker. Sans cela, c'est l'adresse que vous utilisez localement qu'il faut prendre. Vérifiez aussi que Wireguard autorise toutes les IP à traverser le VPN (allowedIPs = 0.0.0.0/0). Il faut que le parefeu du NAS autorise les IPs de Wireguard (10.x.x.x/xx). Mais pas en https je présume, que ce soit localement ou à distance sauf à faire une exception. Ce qui signifie que le certificat n'est pas sollicité et/ou qu'il ne couvre pas le ndd. Pour cela, il faut mettre une règle dans le reverse proxy qui dirige https://xxxx.myds.me port 51821 vers localhost et le port de votre application docker. Ce serait d'ailleurs plus simple d'utiliser le port 443 dans le reverse proxy avec un nom de domaine dédié, par exemple : https://votreapplication/xxx.myds.me port 443 vers localhost et le port de votre application. Je vous conseille d'aller faire un tour dans la section des tutoriels et de regarder le tuto sur le serveur DNS et celui sur le reverse proxy.1 point

Ce classement est défini par rapport à Bruxelles/GMT+02:00